Disponibile GPT-5.5: ancora più intelligente, batte Anthropic e Google in alcuni benchmark (aggiornato: 24 aprile 2026, ore 15:03)

- a cura di: massimo.valenti

- Commenti:

- Letture:

- Aggiornato: 24/04/2026, 15:03

- Pubblicato: 24/04/2026, 15:00

Per favore, aggiungi TurboLab.it alle eccezioni del tuo Ad Blocker. Siamo un progetto no-profit, e la pubblicità è indispensabile per pagare le spese.

In alternativa, puoi sostenerci con una donazione.

Rispetteremo ogni tua scelta, e potrai sempre utilizzare il sito senza limitazioni.

Il nome in codice interno era «Spud», come una patata. Ma quello che OpenAI ha rilasciato oggi - giovedì 24 aprile 2026 - è tutto fuorché un tubero qualunque. GPT-5.5 arriva a meno di due mesi di distanza da GPT-5.4 e rappresenta, nelle parole dell'azienda, «il nostro modello più intelligente e intuitivo». Dietro il linguaggio da comunicato stampa c'è però una direzione precisa: un'intelligenza artificiale che non si limita a rispondere alle domande, ma che opera autonomamente su un computer, pianifica sequenze di azioni complesse e scrive codice con un livello di giudizio che OpenAI paragona a quello di un ingegnere software senior. La domanda non è più se l'AI cambierà il modo in cui sviluppiamo software. È quanto velocemente lo stia già facendo.

La differenza fondamentale tra GPT-5.5 e i suoi predecessori non è solo questione di punteggi nei benchmark - ci arriviamo tra poco - ma di paradigma operativo. Il modello è progettato per eseguire compiti complessi in più passaggi senza che l'utente debba guidarlo uno per uno. Può pianificare, utilizzare strumenti, verificare i propri risultati, gestire l'ambiguità e proseguire lungo catene di operazioni lunghe senza intervento umano.

Greg Brockman, cofondatore e presidente di OpenAI, non ha usato mezzi termini: «Può guardare un problema poco chiaro e capire cosa deve succedere dopo. Per me, davvero, sta gettando le basi per come useremo i computer e per come faremo lavoro al computer d'ora in avanti». E ancora: «Questa è una nuova classe di intelligenza. È un grande passo verso un'informatica più agentica e intuitiva».

Il termine chiave è agentic. Non stiamo parlando di un chatbot più furbo. Stiamo parlando di un sistema che, dato un obiettivo, si muove in un ambiente software reale - terminale, browser, editor di codice - prendendo decisioni su cosa fare, in che ordine e come correggere gli errori lungo il percorso.

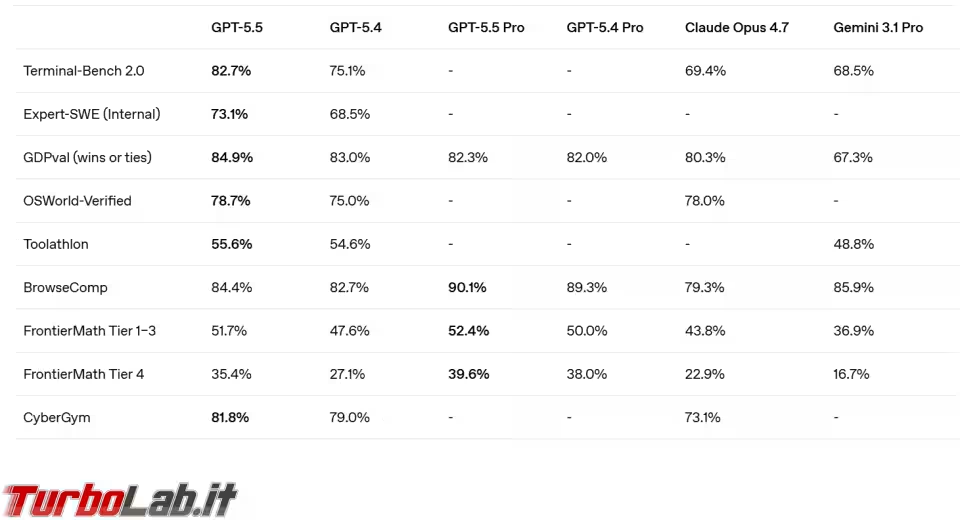

OpenAI ha pubblicato risultati su diversi benchmark progettati per misurare capacità agentiche. Il più significativo è probabilmente Terminal-Bench 2.0, un test che valuta la capacità di gestire flussi di lavoro complessi da riga di comando, richiedendo pianificazione, iterazione e coordinamento tra strumenti. GPT-5.5 raggiunge l'82,7%, contro il 75,1% di GPT-5.4, il 69,4% di Anthropic Opus 4.7 e il 68,5% di Google Gemini 3.1 Pro. Un margine tutt'altro che trascurabile.

Su SWE-Bench Pro - che misura la capacità di risolvere issue reali su GitHub in un singolo passaggio, dall'inizio alla fine - GPT-5.5 segna il 58,6%. Su OSWorld-Verified, che testa la capacità di operare un computer in modo indipendente, il punteggio è del 78,7%. Qui però il vantaggio su Anthropic Opus 4.7 è molto più sottile: appena 0,7 punti percentuali (78,7% contro 78%). Non esattamente un abisso.

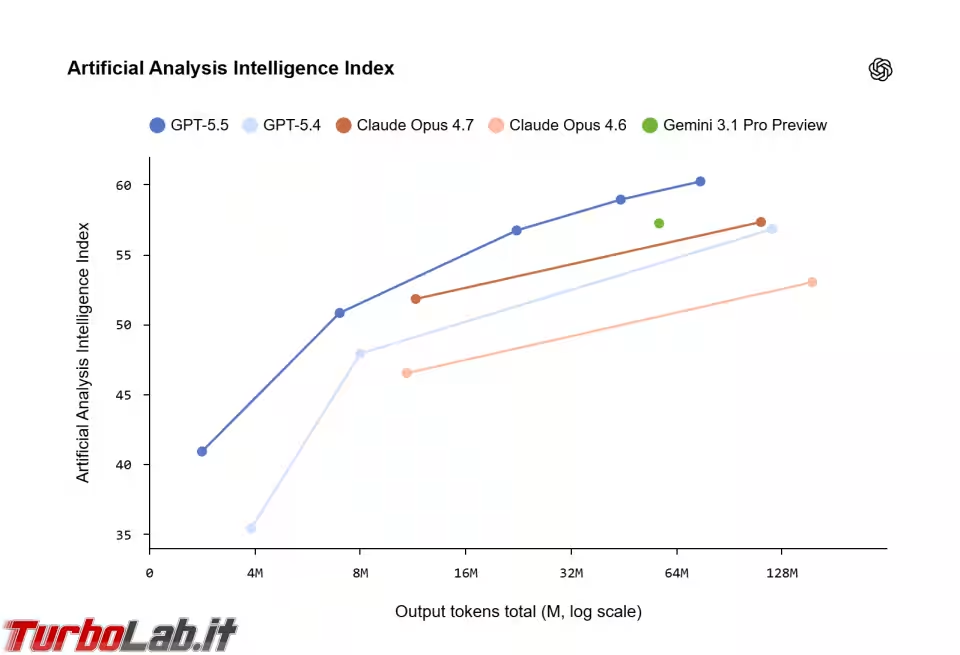

C'è poi la questione dell'efficienza. Secondo la pagina Artificial Analysis Coding Index, GPT-5.5 offre prestazioni all'avanguardia nella programmazione a metà del costo dei modelli concorrenti di punta. Mantiene la stessa latenza per token di GPT-5.4 in condizioni reali di utilizzo, pur essendo più capace, e usa significativamente meno token per completare gli stessi compiti su Codex. Brockman l'ha sintetizzato così: «Un pensatore più veloce e più acuto per meno token».

Il terreno dove GPT-5.5 si fa sentire in modo più concreto è Codex, la piattaforma di programmazione assistita di OpenAI che conta circa 4 milioni di sviluppatori attivi ogni settimana. GPT-5.5 è descritto come il modello di programmazione agentica più forte mai prodotto dall'azienda.

I primi tester riportano che il modello ha una comprensione migliore della «forma» di un sistema software nel suo complesso. Non si limita a generare codice: riesce a identificare perché qualcosa non funziona, dove serve l'intervento e quali altre parti della base di codice verrebbero impattate dalla modifica. È la differenza tra un assistente che scrive la funzione che gli chiedi e un collega che capisce l'architettura del progetto.

Secondo i team che hanno avuto accesso anticipato, il risparmio può arrivare fino a 10 ore di lavoro a settimana, con la possibilità aggiuntiva di revisionare migliaia di documenti in più. È un dato da prendere con le pinze - le stime di produttività dei primi utilizzatori tendono a essere ottimistiche - ma la direzione è chiara.

GPT-5.5 è in fase di distribuzione per gli utenti Plus, Pro, Business ed Enterprise su ChatGPT e Codex. Esiste anche una variante GPT-5.5 Pro, con maggiore accuratezza, riservata agli abbonati Pro, Business ed Enterprise.

L'accesso tramite API, invece, non è ancora disponibile. OpenAI lo promette «molto presto», ma ha spiegato che il ritardo è dovuto alla necessità di implementare misure di sicurezza informatica aggiuntive per la distribuzione su larga scala. Non è un dettaglio da poco: un modello capace di operare autonomamente su un computer è anche un modello che, nelle mani sbagliate, può fare danni seri. E OpenAI sembra esserne consapevole.

Il profilo di rischio di GPT-5.5 merita attenzione. Il modello non supera la soglia che OpenAI definisce «critica» per la sicurezza informatica - quella riservata a «percorsi senza precedenti verso danni gravi». Rientra però nella classificazione di rischio «alto», definita come la capacità di «amplificare percorsi esistenti verso danni gravi». La distinzione è sottile ma importante: non crea nuove minacce, ma rende più potenti quelle che già esistono.

Mia Glaese, vicepresidente della ricerca di OpenAI, ha dichiarato: «GPT-5.5 ha subito test approfonditi da parte di terze parti e sessioni di red teaming per rischi informatici e biologici, e abbiamo lavorato per mesi sulle nostre misure di sicurezza informatica con modelli sempre più capaci in questo ambito». Circa 200 partner con accesso anticipato hanno fornito riscontri prima del rilascio pubblico. Il fatto che l'accesso API richieda «misure di sicurezza diverse» - e che OpenAI stia collaborando con i partner per definire i requisiti - suggerisce che l'azienda prende sul serio la differenza tra un utente che chatta e un sistema automatizzato che agisce.

Il rilascio arriva a una settimana dal lancio dell'ultimo modello di Anthropic, il cosiddetto Claude Mythos Preview, che ha attirato forte attenzione anche in ambito finanziario. I dirigenti di OpenAI hanno descritto in passato l'ascesa di Anthropic come un «codice rosso» e un «campanello d'allarme», stimolando un riorientamento strategico verso i clienti aziendali.

Il ritmo dei rilasci sta chiaramente accelerando. Brockman ha offerto una spiegazione che ha il sapore di un circolo vizioso - o virtuoso, a seconda dei punti di vista: «L'AI stessa sta facendo gran parte del lavoro pesante di programmazione dei sistemi AI». L'AI che costruisce l'AI successiva. Un concetto che fino a poco tempo fa apparteneva alla fantascienza e che ora è semplicemente una descrizione del processo di sviluppo.

Dal lato infrastrutturale, Nvidia non si limita a fornire le GPU su cui GPT-5.5 è stato addestrato. Justin Boitano, vicepresidente del computing enterprise di Nvidia, ha descritto il modello come un potenziale «capo di gabinetto» capace di alimentare agenti che in Nvidia già operano come dipendenti a tutti gli effetti. L'azienda sostiene che i suoi nuovi chip riducono il costo di esecuzione di modelli come GPT-5.5 fino a 35 volte per token. E insieme a OpenAI ha creato «un modello di riferimento per rendere più facile a ogni azienda implementare tutto questo».

La vera domanda, per i milioni di sviluppatori che aprono un terminale ogni mattina, non riguarda i punteggi nei benchmark. Riguarda il cambiamento qualitativo nel rapporto con lo strumento. Un modello che capisce l'architettura di un progetto, che sa dove mettere le mani e che può lavorare autonomamente su catene di operazioni lunghe non è un autocompletamento glorificato. È un collaboratore - con tutti i benefici e le complessità che questo comporta.

I numeri di dimensione del modello restano avvolti nel mistero. Alcune speculazioni parlano di 10 trilioni di parametri, ma Brockman ha rifiutato di confermare. Quello che è certo è che GPT-5.5 consuma meno token e produce risultati migliori con meno tentativi rispetto ai modelli precedenti. Per chi paga per token, questo si traduce direttamente in denaro risparmiato.

Brockman ha inquadrato il tutto in una cornice ancora più ampia: «Ci stiamo muovendo verso un'economia alimentata dalla potenza di calcolo», descrivendo il compute come il fondamento dell'attività economica futura. Una visione che ha il pregio della coerenza - OpenAI vende compute, dopotutto - ma che riflette una trasformazione reale. Quando un modello può prendere un ticket su GitHub, capire il problema, scrivere la correzione e verificare che non rompa nient'altro, il ruolo dello sviluppatore si sposta. Non scompare. Si sposta verso la supervisione, la progettazione architetturale, il giudizio. Esattamente il tipo di lavoro che, per ora, resta difficile da delegare a una patata - anche una molto intelligente.

Fonti: cnbc.com, openai.com, fastcompany.com

Nessuno ha ancora commentato.